Lutter contre les préjugés socioéconomiques dans l'apprentissage automatique à l'aide de l'ensemble de données Dollar Street

Malgré l'essor fulgurant du ML, la plupart des ensembles de données disponibles dans le commerce ne représentent qu'une petite fraction de l'humanité, avec un biais vers les populations à revenu élevé. Pour résoudre ce problème, nous avons co-créé le programme d'accès libre Ensemble de données de la rue Dollar, aux côtés de nos partenaires de Gapminder, de l'Université Harvard et de MLCommons.

En reformant un modèle de CV établi sur ce nouvel ensemble de données socioéconomiquement diversifié, nous avons amélioré de 50 % la précision de la classification pour les éléments provenant de ménages à faible revenu.

Nous avons également été en mesure d'augmenter le rendement du modèle dans tous les quartiles de revenu à un taux de réussite moyen de 75 %. Dans cet article, nous expliquerons comment la communauté de l'IA et les chefs d'entreprise peuvent utiliser l'ensemble de données Dollar Street pour lutter contre les biais socio-économiques dans leurs algorithmes.

Le jeu de données Dollar Street est un projet collaboratif à but non lucratif entre une ONG suédoise. Gapminder, internationale sans but lucratif ML Commons, Université Harvard, et démarrage de l'apprentissage automatique IA coactive. Nous sommes unis dans notre détermination à lutter contre les préjugés socio-économiques — que ce soit dans les personnes, les algorithmes ou les systèmes sociaux.

En bref : le biais algorithmique et ses impacts

[Image source, crédit d'image : N. Hanacek/NIST]

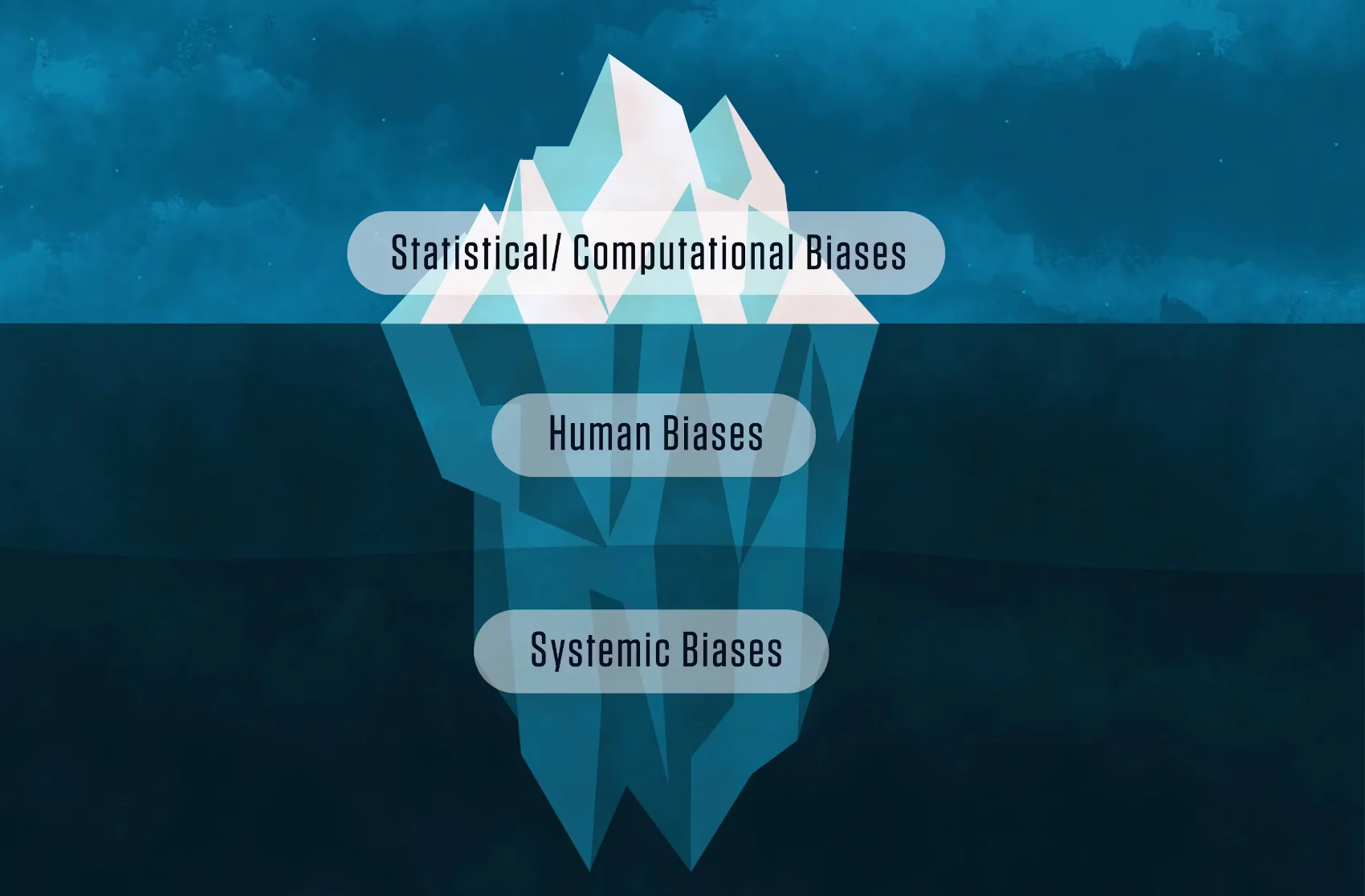

Les biais algorithmiques affectent quotidiennement les gens, nuisent de manière disproportionnée aux femmes et aux personnes de couleur, et creusant les inégalités sociales [1, 2]. Par exemple, les meilleurs outils de CV de l'industrie identifient à tort les femmes à la peau plus foncée 1 fois sur 3 [3], et les biais algorithmiques dans le système de justice pénale mènent à des arrestations injustifiées au sein des communautés minoritaires [4].

L'absence historique d'ensembles de données d'entraînement diversifiés et de haute qualité est un facteur causal important de biais algorithmique [5, 6]. Nous avons enseigné à nos modèles de ML à voir le monde à travers une lentille améro/eurocentrique étroite [7, 8].

Nos propres valeurs et désirs influencent nos choix, des données que nous choisissons de recueillir aux questions que nous posons. Les modèles sont des opinions ancrées dans les mathématiques. »

Cathy O'Neil, Armes de destruction mathématique : comment les mégadonnées augmentent les inégalités

Pour lutter contre les biais algorithmiques, les entreprises doivent former leurs algorithmes d'apprentissage automatique sur des ensembles de données représentatifs tous les populations qui seront touchées par le déploiement de l'IA. Les entreprises modernes et les équipes des RH ont appris qu'une main-d'œuvre inclusive et diversifiée est plus performante, et il est temps pour la communauté du ML d'appliquer la même sagesse à ses données de formation, d'autant plus que leurs produits et services commencent à avoir un impact sur des milliards de personnes dans les économies émergentes et les pays en développement [9, 10].

Comment l'ensemble de données Dollar Street peut-il aider à lutter contre les biais algorithmiques ?

L'ensemble de données Dollar Street est un ensemble de données en libre accès conçu pour lutter contre les préjugés socioéconomiques. Nous espérons qu'il inspirera et permettra aux développeurs de ML de proposer des algorithmes plus inclusifs sur le plan socioéconomique et un avenir plus juste pour toutes les communautés.

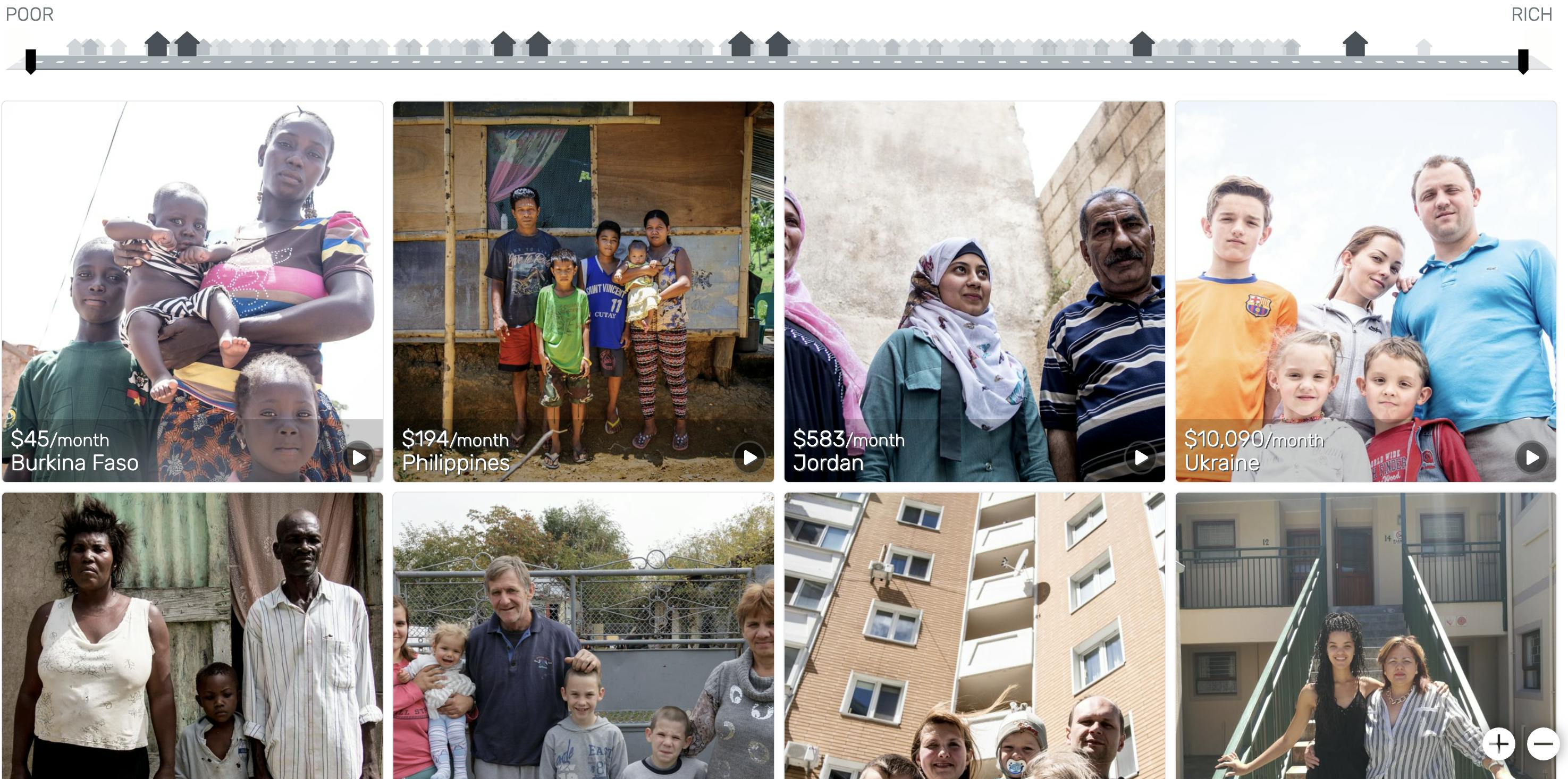

L'ensemble de données est bien adapté pour peaufiner les modèles de CV. Il contient plus de 38 000 images d'articles ménagers avec des étiquettes démographiques très détaillées, notamment l'emplacement, la région, les objets et le revenu du ménage. 63 pays sont représentés, y compris des communautés qui n'ont pas encore accès à Internet, et toutes les métadonnées ont été générées et vérifiées par des humains grâce au travail minutieux de Gapminder.

Nous avons testé l'ensemble de données Dollar Street sur des tâches de classification d'images à l'aide de cinq des modèles de CV préformés les plus largement adoptés. Nous avons constaté une corrélation entre l'exactitude de la classification des articles ménagers et le revenu du ménage. En fait, nous avons montré que la précision diminue de 57 % pour les maisons à revenu élevé à seulement 18 % pour les maisons à faible revenu.

Cependant, en utilisant la Ensemble de données de la rue Dollar pour peaufiner l'un des modèles préformés, nous avons été en mesure de surmonter le biais socioéconomique initial du modèle et d'obtenir une précision de classification d'environ 75 p. 100 pour tous les revenus. Autrement dit, sans changer le modèle lui-même, nous avons pu éliminer l'écart de performance algorithmique entre les ménages riches et les ménages pauvres.

Comment l'ensemble de données Dollar Street a-t-il été créé ?

Ce projet est le fruit d'une collaboration entre trois organisations. Elle s'appuie sur la Projet de la rue Dollar par Gapminder, un organisme suédois sans but lucratif. Gapminder a coordonné rigoureusement un réseau international de professionnels et de bénévoles pour recueillir les données nécessaires. Ces personnes ont visité des centaines de foyers dans 63 pays, recueillant des dizaines de milliers d'images et de détails de métadonnées, toutes validées manuellement par Gapminder. Nous croyons qu'il s'agit de l'un des premiers ensembles de données à avoir été recueillis de cette façon à une telle échelle.

Les données ont été intégrées à l'outil interactif de Gapminder appelé Rue Dollar. L'outil aide à renseigner les gens sur la répartition des revenus à l'échelle mondiale et sur la façon dont la qualité de vie varie géographiquement (Consultez le Discuter TED par Anna Rosling Rönnlund, cofondatrice de Gapminder, qui met en valeur la puissance de ces idées). Cependant, cet outil initial a été conçu pour éduquer les gens ordinaires. Pour mettre les données à la disposition des praticiens du ML, il fallait adopter une approche différente, c'est là que Coactive AI, l'Université Harvard et ML Commons sont intervenus.

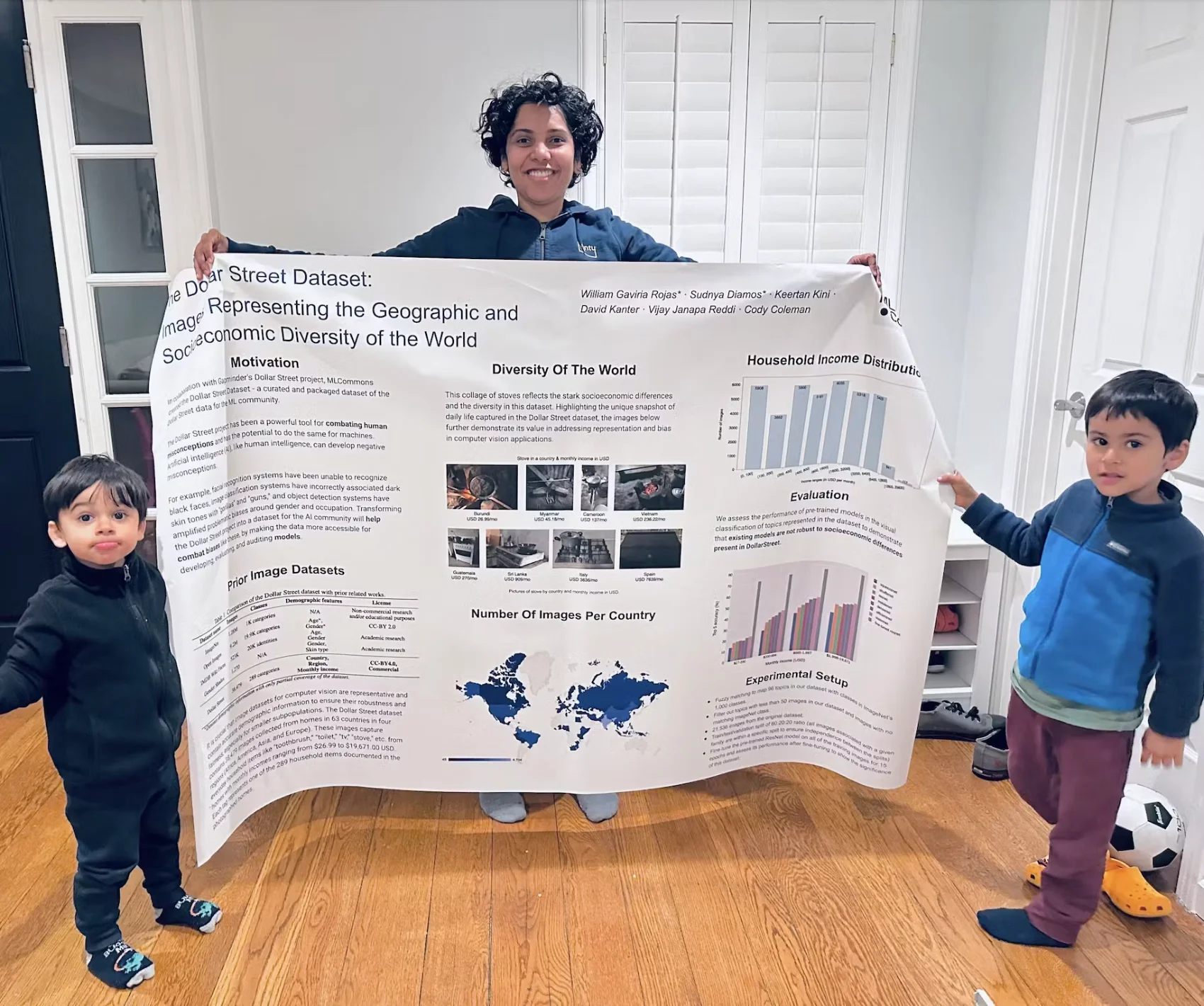

L'IA coactive a fourni l'expertise et les ressources nécessaires pour rendre l'ensemble de données utilisable pour les ingénieurs en apprentissage automatique du monde entier. ML Commons et l'Université Harvard ont assumé la responsabilité vitale d'héberger et de maintenir l'ensemble de données et de le rendre accessible en permanence à tous sous une licence Creative Commons (CC-BY).

[Sudnya Diamos, ingénieure logiciel chez CoactiveAI et co-auteure principale de la publication The Dollar Street Dataset, se prépare à présenter les conclusions de son équipe à NeurIPS 2022.]

Nos organisations reconnaissent chacune qu'une représentation adéquate est un antidote clé aux biais algorithmiques, et ce projet est notre effort conjoint visant à fournir une solution à l'échelle de l'industrie et à galvaniser des changements positifs.

Sommaire

Ce projet n'aurait pas été possible sans les efforts incroyables de la fondation Gapminder pour créer les données sources et le soutien de MLCommons pour rendre l'ensemble de données conservées accessible au public.

En entraînant des algorithmes d'apprentissage automatique à l'aide de divers ensembles de données tels que le jeu de données Dollar Street, nous pouvons aider à combler l'écart de performance en apprentissage automatique qui affecte de manière disproportionnée les communautés sous-représentées.

Au début de cet article, nous avons brièvement expliqué comment les algorithmes peuvent involontairement être racistes, sexistes et classistes [11, 12], et que ces préjugés implicites nuisent le plus aux personnes vulnérables [13]. En plus de l'obligation morale des praticiens de l'IA de s'attaquer à ce problème, les changements de politique intérieure et les forces du marché mondial nécessiteront probablement bientôt des mesures anti-biais et plus de transparence algorithmique [14, 15, 16].

L'IA responsable peut offrir un monde plus juste et meilleur pour tout le monde, et nous espérons que l'ensemble de données Dollar Street catalysera un changement positif. Nous demandons aux utilisateurs de cet ensemble de données d'adopter une approche avant-gardiste et éthique pratiques exemplaires dans son déploiement.

Avec cette recherche, nous avons cherché à démontrer la preuve de concept. Nous espérons que l'ensemble de données Dollar Street permettra aux praticiens de l'IA commerciaux et universitaires d'accéder à des données de formation de haute qualité et représentatives sur le plan socioéconomique et de s'attaquer à une source clé de biais algorithmique. Pour plus de détails sur notre méthodologie, veuillez consulter notre NeuroIP papier.

Si vous êtes un ingénieur en apprentissage automatique, nous vous demandons de le tester ou d'aider à faire passer le mot. Le Ensemble de données Dollar Street est simple à télécharger et à utiliser, et il peut être inclus dans la plupart des solutions de vision par ordinateur existantes.